이 콘텐츠는 뉴스쿨 News'Cool이 2026년 3월 6일에 발행한 제188호 이번 주 뉴스쿨입니다.

이번 주 뉴스쿨에서 다루는 이야기는...

- HEADLINE - 인공지능 클로드, 전쟁을 진두지휘하다

- 뉴스쿨TV - 똑똑하지만 위험한 AI, 어떻게 써야 할까?

- PLAY - 착한 AI 만들기 프로젝트

- BOOKCLUB - AI 시대를 대비하려면?

무기가 된 인공지능

전쟁을 진두지휘하다

지난달 28일 오전(현지시간), 미국과 이스라엘은 전투기 100여 대를 동원해 이란을 공격했습니다. 공격 직전에는 이란의 통신과 감시 장비를 먹통으로 만들었고, 이란은 갑작스러운 공격에 제대로 대응하지 못했습니다. 이 공습으로 37년간 이란을 지배한 최고지도자 아야톨라 알리 하메네이가 사망했습니다. 그런데 이 작전에는 놀라운 비밀이 있었습니다. 미군이 인공지능(AI)을 이용해 최적의 공격 시간과 장소, 구체적인 공격 방법을 결정했다는 겁니다.

절묘한 타이밍에 급소만 골라 타격

미국 국방부가 이번 공습에 사용한 AI의 이름은 '클로드'입니다. 미군은 위성으로 찍은 사진, 몰래 녹음한 통신 내용, 여러 전자 신호 같은 어마어마한 양의 자료를 클로드에게 맡겼습니다. 클로드는 이 자료들을 아주 빠르게 읽고 분석해서 어디를, 언제, 어떻게 공격해야 이란에 치명상을 입힐 수 있는지 정리했습니다. 사람이라면 며칠이 걸릴 일을 AI는 단 몇 시간 만에 해낸 겁니다. 특히 이란 지도부가 어디에서 움직이는지 추적하는 데에도 AI가 큰 역할을 했습니다. 미국이 오랫동안 모아 온 정보를 AI로 한꺼번에 분석해 하메네이를 포함한 이란의 주요 인물들이 있는 장소 등을 찾아냈고 이를 전쟁에서 활용해 성공 확률을 끌어 올린 것입니다.

또한 미국은 여러 첨단 기술을 활용해 이란을 공격했습니다. 우선 공격 직전에 사이버 공격으로 이란의 통신망을 마비시켰습니다. 이란군은 서로 연락할 수도, 상황을 제대로 파악할 수도 없었습니다. 여기에 인공위성과 AI, 그리고 정찰과 공격을 도맡는 드론까지 함께 움직인 겁니다. 과거에는 전쟁이 벌어질 때 탱크와 전투기의 수가 중요했습니다. 하지만 이번 전쟁은 첨단 기술의 차이가 전쟁의 승패를 결정한다는 사실을 보여주고 있습니다.

"AI 무기화 반대" 목소리 잇따라

클로드가 미국의 중요한 군사 작전에 활용된 건 이번이 처음이 아닙니다. 올해 1월 미국은 베네수엘라 대통령을 체포하는 과정에서도 클로드를 활용했습니다. 하지만 클로드를 만든 회사인 '앤트로픽'은 클로드가 전쟁에 쓰이는 것을 반대하고 있습니다. 특히 '완전 자율 무기'로 사용되는 것을 가장 우려하고 있는데요. 완전 자율 무기란 사람이 전혀 개입하지 않고 AI가 스스로 목표를 찾고, 판단하고, 공격까지 하는 무기를 말합니다.

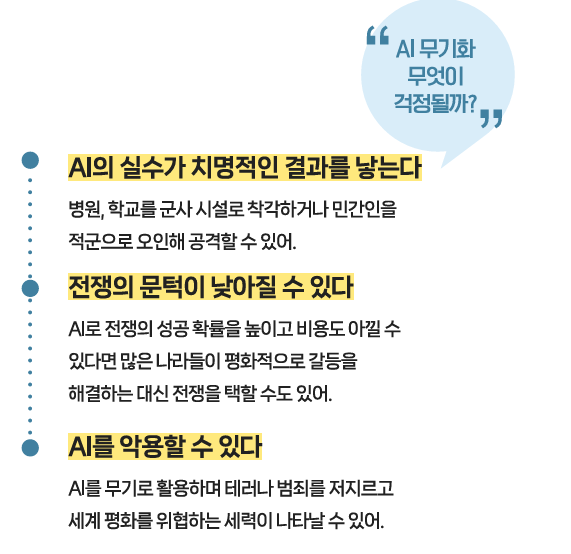

많은 사람들이 AI를 완전 자율 무기로 사용하는 것을 반대하는 이유는 아무리 똑똑한 AI도 얼마든지 실수할 수 있기 때문입니다. 예를 들어 AI가 병원을 군사 시설로 잘못 판단하면 어떻게 될까요? 사람은 병원이라는 사실을 알차내는 순간 공격을 멈출 수 있지만 AI는 병원이더라도 전쟁에서 승리하는 데 유리하다면 공격해버릴 수도 있어요. 특히 AI가 이 모든 과정을 혼자 결정하고 공격까지 한다면 실수를 막을 방법이 없습니다. 게다가 AI가 틀린 판단을 내렸을 때 누가 책임져야 하는지도 아직 정해지지 않았습니다. 그래서 앤트로픽은 "지금의 AI 기술은 사람의 생사를 혼자 결정할 만큼 믿을 수 있는 수준이 아니"라고 강조합니다.

이런 이유로 앤트로픽뿐만 아니라 다른 AI 기업들도 이번 사태에 목소리를 높이고 있습니다. 최근 구글(제미나이)과 오픈AI(챗GPT) 직원들은 온라인을 통해 공개적으로 미국 정부에 'AI 무기화'를 우려하는 내용의 편지를 보냈는데요. 여기에는 약 1000명의 직원들이 서명했다고 해요.

반면 AI의 군사적 활용을 완전히 막을 수 없다고 보는 시각도 있습니다. AI를 군사적으로 활용하면 사람 병사가 직접 위험한 전장에 나가지 않아도 되고, 작전 실수를 줄여 오히려 민간인 피해를 줄일 수 있다는 주장이에요. 또 한 나라가 AI 무기 개발을 멈춰도 다른 나라가 계속 개발한다면 결국 혼자만 뒤처지게 된다는 현실적인 이유도 있습니다. 그래서 많은 나라들이 "AI 무기는 안 된다"고 말하면서도 실제로는 개발을 멈추지 않고 있는 것이 현실입니다.

실제로 AI는 이미 군사 작전은 물론 각 나라의 안보 정책을 결정할 때도 핵심적인 도구가 됐습니다. 그리고 앞으로 그 역할은 더욱 커질 것입니다. 이처럼 기술이 빠르게 발전하는 만큼 AI를 군사적인 목적으로 어디까지 이용해도 되는지 서둘러 규칙을 정해야 한다는 목소리도 높아지고 있습니다. 지금 유엔(UN)에서는 자율 무기를 규제하자는 논의가 진행 중이지만, 일부 국가들은 반대하고 있습니다.

1. 오늘 이야기의 핵심 내용은 무엇일까?

2. AI가 전쟁에서 사람 대신 결정을 내리는 것은 왜 위험할까?

3. AI가 민간인을 공격하거나 인간에게 해가 되는 실수를 저질렀을 때 누가 책임져야 할까?